Amazon, Alphabet, Meta et Microsoft s’apprêtent à dépenser collectivement l’équivalent du PIB trimestriel de la France en une seule année. Une surenchère historique qui transforme l’IA d’expérience technologique en infrastructure industrielle de première nécessité et redéfinit les rapports de force économiques et géopolitiques pour les décennies à venir. Dominé par le trio AWS, Microsoft Azure et Google Cloud, le secteur s’oriente vers des solutions hybrides et une valeur totale projetée dépassant 1 000 milliards de dollars à court terme.

Un tournant historique pour l’intelligence artificielle

En 2026, quatre entreprises américaines, Amazon, Alphabet (Google), Meta et Microsoft, s’apprêtent à investir collectivement plus de 650 milliards de dollars dans l’intelligence artificielle et les infrastructures cloud. La référence en investissement devient le milliard de dollars.

Pour donner une idée de l’ampleur de ce chiffre, cela représente approximativement le Produit Intérieur Brut trimestriel de la France, qui s’élevait à environ 662 milliards d’euros fin 2025. Autrement dit, ces quatre seules entreprises vont dépenser en un an ce qu’une économie majeure comme la France produit en trois mois.

Cette vague d’investissements n’est pas une simple augmentation budgétaire, elle marque une accélération historique. Entre 2025 et 2026, les dépenses de ces quatre acteurs devraient croître de 67 à 74%, passant de 381 milliards à plus de 650 milliards de dollars. Cette explosion s’explique par une transformation fondamentale comme l’IA générative (capable de créer du texte, des images ou du code) qui est passée du stade expérimental à celui de la production massive, exigeant des infrastructures colossales.

Amazon, le leader historique qui ne relâche pas la pression

Amazon n’est pas nouveau dans les investissements massifs. Le géant du commerce en ligne, via sa branche cloud AWS (Amazon Web Services), est déjà celui qui dépense le plus depuis des années. Ses investissements sont passés de 40 milliards de dollars en 2020 à 128 milliards en 2025, soit une multiplication par trois en cinq ans.

Pour 2026, le PDG Andy Jassy a annoncé un budget d’environ 200 milliards de dollars, un chiffre qui a provoqué une chute de plus de 8 % du cours de l’action Amazon, les analystes s’attendant à des dépenses plus modestes (autour de 146 milliards). Cette somme pharaonique servira principalement à répondre à la demande explosive pour les services d’IA, mais aussi à des projets futuristes comme la robotique et les satellites en orbite basse.

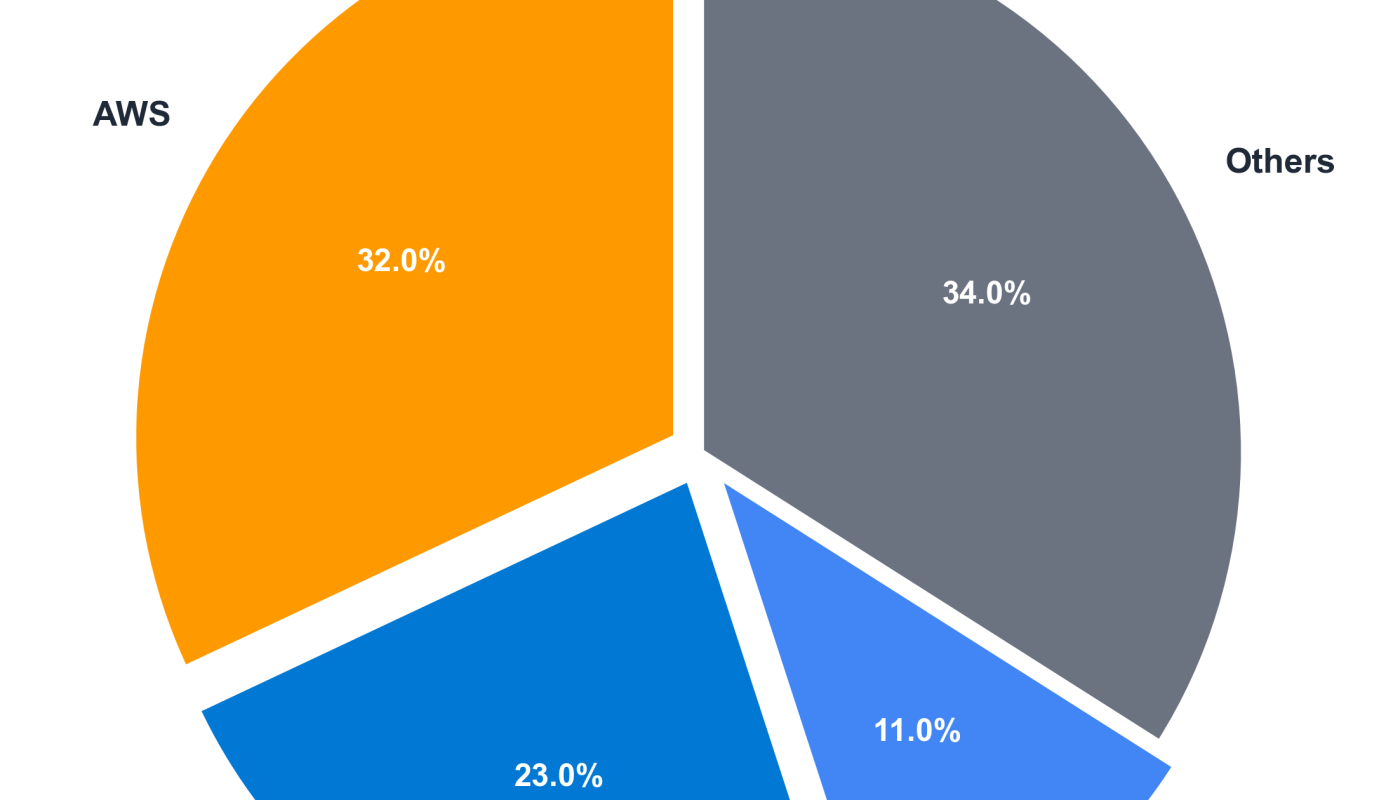

AWS reste le leader absolu du cloud mondial avec 32 % de parts de marché et un carnet de commandes (backlog) de 244 milliards de dollars, ce qui garantit des revenus prévisibles sur plusieurs années. L’entreprise a également lancé des outils comme Amazon Q, un assistant IA pour les entreprises, et sa plateforme Nova, qui permet d’intégrer des données propriétaires dans les modèles d’IA.

Alphabet/Google, la montée en puissance de Gemini

Google, via sa maison mère Alphabet, connaît un moment exceptionnel. L’année 2025 a été marquée par le lancement de Gemini 3, le dernier-né de ses modèles d’IA, qui a permis à l’entreprise de dépasser pour la première fois les 400 milliards de dollars de chiffre d’affaires annuels. Le succès est tangible car plus de 8 millions de licences payantes de Gemini Enterprise ont été vendues en seulement quatre mois, et l’application compte désormais 750 millions d’utilisateurs actifs mensuels.

Pour 2026, Alphabet prévoit d’investir entre 175 et 185 milliards de dollars, puis a même révisé cette fourchette à 180-190 milliards au printemps 2026, bien au-dessus des estimations initiales des analystes (119-140 milliards). Cette confiance s’explique par les résultats de Google Cloud, dont les revenus ont grimpé de 63% en un an pour atteindre 20 milliards de dollars au premier trimestre 2026. Le carnet de commandes de Google Cloud a quasiment doublé en trois mois, atteignant 240 milliards de dollars.

Cependant, une ombre au tableau car la croissance du nombre d’utilisateurs de Gemini a ralenti au quatrième trimestre 2025, n’étant plus que d’un tiers de celle du trimestre précédent. Google compense en poussant ses utilisateurs de Search vers son mode IA complet, espérant que l’absence de publicité rendra son outil plus attractif que ChatGPT.

Meta, le pari de la « superintelligence personnelle »

Mark Zuckerberg, PDG de Meta (Facebook, Instagram, WhatsApp), ne fait pas dans la demi-mesure. Après avoir annoncé en janvier 2025 des investissements de 60-65 milliards de dollars, il a progressivement revu ses ambitions à la hausse avec 70-72 milliards en octobre, puis un plan pluriannuel de 600 milliards de dollars jusqu’en 2028, soit 150 à 200 milliards par an.

Pour 2026, Meta table sur une fourchette de 115 à 135 milliards de dollars, qu’elle a encore relevée à 125-145 milliards en avril 2026. Ces sommes colossales alimenteront les travaux des Meta Superintelligence Labs, avec l’objectif affiché de développer une « superintelligence personnelle » accessible à tous. L’entreprise mise également sur ses modèles Llama (open-source, c’est-à-dire librement accessibles) et sur l’amélioration de sa publicité ciblée par l’IA.

Curieusement, contrairement à ses concurrents, l’annonce de Meta a été bien accueillie par les marchés, car l’IA a déjà démontré son efficacité pour booster les revenus publicitaires du groupe.

Microsoft, le discret mais redoutable compétiteur

Microsoft, sous la direction de Satya Nadella, adopte une approche plus discrète mais tout aussi ambitieuse. L’entreprise a déjà dépensé 72,4 milliards de dollars lors du premier semestre de son année fiscale 2026 (qui court de juillet 2025 à juin 2026). Sa directrice financière Amy Hood a annoncé un investissement total de 190 milliards de dollars pour l’année fiscale 2026, dépassant largement les prévisions des analystes (90-100 milliards).

Microsoft mise sur son partenariat stratégique avec OpenAI (créateur de ChatGPT) et sur son cloud Azure, dont la croissance atteint 40 %. L’entreprise a également développé Copilot, un assistant IA intégré à Microsoft 365 (Word, Excel, Outlook), et investit massivement dans des centres de données répartis dans sept pays pour répondre aux exigences de souveraineté des données.

Un détail rassurant pour les investisseurs car Amy Hood a comparé le cycle actuel de l’IA à celui du cloud il y a dix ans, notant que les marges bénéficiaires de l’IA sont déjà meilleures que celles du cloud à une étape comparable.

Oracle, l’outsider qui tente de rattraper son retard

Tandis que le « Big Four » accélère, Oracle peine à suivre le rythme. Souvent présenté comme le « quatrième acteur du cloud », l’entreprise a pourtant un atout majeur avec son partenariat avec OpenAI dans le cadre du projet Stargate, un plan d’infrastructure colossal visant à déployer 10 gigawatts de capacité de calcul IA.

Oracle prévoit de lever entre 45 et 50 milliards de dollars en 2026 via dette et émissions d’actions pour financer son expansion. Son carnet de commandes (RPO) a bondi à plus de 523 milliards de dollars, signe d’une demande contractuelle soutenue. Cependant, cette stratégie est risquée car elle dépend étroitement de la stabilité financière d’OpenAI, qui n’est pas encore rentable et dont le modèle économique reste incertain.

Le projet Stargate, lancé en janvier 2025 avec un investissement initial de 100 milliards de dollars devant grimper à 500 milliards d’ici 2028, implique également SoftBank et des fonds souverains comme MGX (Abu Dhabi). Le premier site, à Abilene au Texas, emploie déjà plus de 6 400 ouvriers et devrait accueillir 450 000 processeurs graphiques (GPU) NVIDIA d’ici mi-2026.

Pourquoi cette course folle ?

Cette surenchère d’investissements s’explique par plusieurs facteurs convergents :

1. La demande explosée pour l’IA générative

Les entreprises du monde entier intègrent désormais l’IA dans leurs processus métier comme la génération de code, l’analyse de documents juridiques, l’optimisation de la chaîne d’approvisionnement, le service client automatisé. Chaque entreprise du Fortune 500 qui déploie des modèles de langage internes crée une demande récurrente d’accès à des clusters de GPU.

2. La concurrence féroce entre hyperscalers

Le marché mondial du cloud a atteint près de 400 milliards de dollars en 2025 et devrait dépasser 500 milliards en 2026 (+27 %). AWS domine avec 32 % de parts, suivi d’Azure (22 %) et Google Cloud (12 %). Google, bien que troisième, affiche la croissance la plus forte (+50 %), ce qui pourrait indiquer qu’il gagne des parts de marché.

3. La pénurie de puissance de calcul

Les puces spécialisées (GPU), essentielles pour l’IA, sont extrêmement coûteuses et rares. NVIDIA, qui détient environ 78 % du marché des GPU d’entraînement IA, vend ses processeurs à des prix premium. Les deux tiers des investissements des hyperscalers servent à acquérir ces puces et les serveurs associés.

4. La souveraineté nationale

L’IA est devenue une ressource stratégique comparable aux réserves énergétiques. 47 gouvernements nationaux ont annoncé des programmes d’infrastructure IA, représentant plus de 84 milliards d’investissements publics d’ici 2030. L’Union européenne, l’Arabie saoudite, le Japon et l’Inde investissent massivement pour ne pas dépendre des infrastructures américaines.

5. Le risque de sous-investir

Comme le note Shai Luft, co-fondateur de Bench Media : « Le plus grand risque n’est pas la confiance excessive, c’est le sous-investissement qui laisserait les produits centraux, recherche, cloud, publicité, exposés à la disruption ». Autrement dit, ne pas investir massivement aujourd’hui, c’est risquer d’être évincé demain.

Les défis de cette expansion

Cette croissance vertigineuse soulève des défis considérables. D’ici 2035, la capacité des centres de données des hyperscalers devrait être multipliée par six, passant de 24 à 147 gigawatts. Or, l’énergie devient le principal facteur limitant car les centres de données IA pourraient consommer 8,5 % de l’électricité américaine d’ici 2030.

Les investisseurs, de leur côté, manifestent un scepticisme « sain ». Après l’euphorie de 2023-2024, les marchés réclament désormais des preuves de rentabilité. Alphabet a vu son action grimper de 7% après ses résultats cloud, tandis que Microsoft a chuté de 11% malgré des investissements record, car la croissance d’Azure a légèrement déçu. La formule de Zuckerberg résume bien la tension en disant « Nous construisons d’abord des expériences pour des milliards de personnes, et nous les monétisons une fois qu’elles ont atteint l’échelle ». Une approche que Wall Street trouve parfois trop floue à court terme.

Alors que le marché du cloud continue de croître pour atteindre 1 000 milliards de dollars, la concurrence entre AWS, Azure et Google Cloud va s’intensifier, favorisant l’innovation, les réductions de prix et l’amélioration des services pour les entreprises clientes. Les fournisseurs qui sauront le mieux répondre aux besoins des entreprises en matière de capacités d’IA, de sécurité, de conformité et d’optimisation des coûts gagneront des parts de marché, tandis que ceux qui ne parviendront pas à s’adapter risquent de perdre du terrain dans ce secteur technologique crucial.

Enfin, pour résumer, nous assistons à l’une des plus grandes restructurations industrielles de l’histoire moderne. En un an, quatre entreprises vont consacrer l’équivalent du budget annuel de la défense américaine à des infrastructures immatérielles, des centres de données, des puces, des algorithmes. Cette course à l’IA redéfinit les rapports de force technologiques, énergétiques et géopolitiques pour les décennies à venir.

Glossaire des termes techniques

Hyperscaler

Terme désignant les opérateurs de cloud computing de très grande échelle (Amazon AWS, Microsoft Azure, Google Cloud, etc.) capables de fournir des ressources informatiques massives à des millions d’utilisateurs simultanément. Le préfixe « hyper » souligne leur taille bien supérieure aux centres de données traditionnels.

CapEx (Capital Expenditure / Dépenses d’investissement)

Sommes consacrées à l’acquisition d’actifs physiques durables — bâtiments, serveurs, équipements — par opposition aux OpEx (dépenses opérationnelles) qui couvrent les coûts courants comme les salaires ou l’électricité. En comptabilité, le CapEx est « capitalisé » : il apparaît au bilan et est amorti sur plusieurs années.

GPU (Graphics Processing Unit / Processeur graphique)

Puce électronique initialement conçue pour le rendu d’images (jeux vidéo), redevenue essentielle pour l’IA car sa structure parallèle permet d’effectuer simultanément des millions de calculs simples, idéale pour entraîner les modèles de langage.

Backlog / Carnet de commandes (RPO : Remaining Performance Obligations)

Valeur des contrats signés avec des clients mais dont les services n’ont pas encore été entièrement livrés. Un backlog élevé (244 milliards pour AWS, 240 pour Google Cloud) indique une demande future garantie et prévisible.

Modèle de langage (LLM – Large Language Model)

Système d’IA entraîné sur d’immenses quantités de texte pour comprendre et générer du langage naturel. GPT (OpenAI), Gemini (Google) et Llama (Meta) en sont les exemples les plus connus. Ces modèles nécessitent des milliers de GPU fonctionnant pendant des mois pour leur « entraînement ».

Inference vs Entraînement

L’entraînement consiste à « apprendre » au modèle à partir de données massives ; l’inference consiste à utiliser le modèle déjà entraîné pour répondre à des requêtes. L’entraînement est très gourmand en calcul mais ponctuel ; l’inference est permanente et représente la majorité des coûts opérationnels à long terme.

Souveraineté des données

Principe selon lequel les données d’un pays ou d’une entreprise doivent être stockées et traitées sur le territoire concerné, hors de portée des juridictions étrangères. Microsoft a investi dans des centres de données dans sept pays pour répondre à cette exigence croissante.

Projet Stargate

Initiative lancée en janvier 2025 par OpenAI, SoftBank et Oracle pour construire 10 gigawatts de capacité de calcul IA aux États-Unis (puis à l’international), avec un budget de 100 à 500 milliards de dollars. Un gigawatt équivaut à la consommation d’environ 750 000 foyers américains.

Cloud computing / Informatique en nuage

Modèle consistant à fournir des ressources informatiques (serveurs, stockage, bases de données, logiciels) via Internet, à la demande, sans que l’utilisateur n’ai à posséder l’infrastructure physique. Les trois modèles principaux sont IaaS (infrastructure), PaaS (plateforme) et SaaS (logiciel).

Open-source

Modèle de développement où le code source d’un logiciel est rendu public et peut être utilisé, modifié et redistribué librement. Meta a choisi cette approche pour ses modèles Llama, contrairement à OpenAI qui garde ses modèles propriétaires.

Sources

Des articles de presse sur les investissements 2026 des hyperscalers (Amazon, Alphabet, Meta, Microsoft, Oracle), incluant les déclarations des dirigeants (Andy Jassy, Sundar Pichai, Mark Zuckerberg, Amy Hood, Susan Li) et les données financières du quatrième trimestre 2025 / premier semestre 2026.

Article TechCrunch, mai 2026 — analyse des dépenses d’investissement des hyperscalers, croissance de 67-74 % entre 2025 et 2026, réactions des marchés aux annonces de Meta et Amazon.

Rapport Synergy Research Group, avril 2026 — parts de marché du cloud (AWS 32 %, Azure 22 %, Google Cloud 12 %), chiffre d’affaires mondial du cloud, données sur les backlogs d’AWS et Google Cloud.

Analyse Reuters, mars 2026 — évaluation des risques liés au partenariat Oracle-OpenAI, incertitudes sur le modèle économique d’OpenAI et sa rentabilité.

Rapport McKinsey Global Institute, février 2026 — demande en IA générative, pénurie de GPU (78 % de part de marché pour NVIDIA), programmes d’infrastructure IA de 47 gouvernements, consommation énergétique des centres de données.

Étude Goldman Sachs, janvier 2026 — projections de capacité des centres de données des hyperscalers (24 à 147 gigawatts d’ici 2035).

Communiqué AWS, avril 2026 — lancement d’Amazon Q et de la plateforme Nova pour l’intégration de données propriétaires dans les modèles d’IA.

Article Wall Street Journal, avril 2026 — détails sur le projet Stargate (10 gigawatts, 100-500 milliards de dollars), partenariat OpenAI-Oracle-SoftBank, site d’Abilene au Texas, 6 400 ouvriers, 450 000 GPU NVIDIA.

Interview Shai Luft, Bench Media, mai 2026 — citation sur le risque de sous-investissement face à la disruption technologique.

Et d’autres…